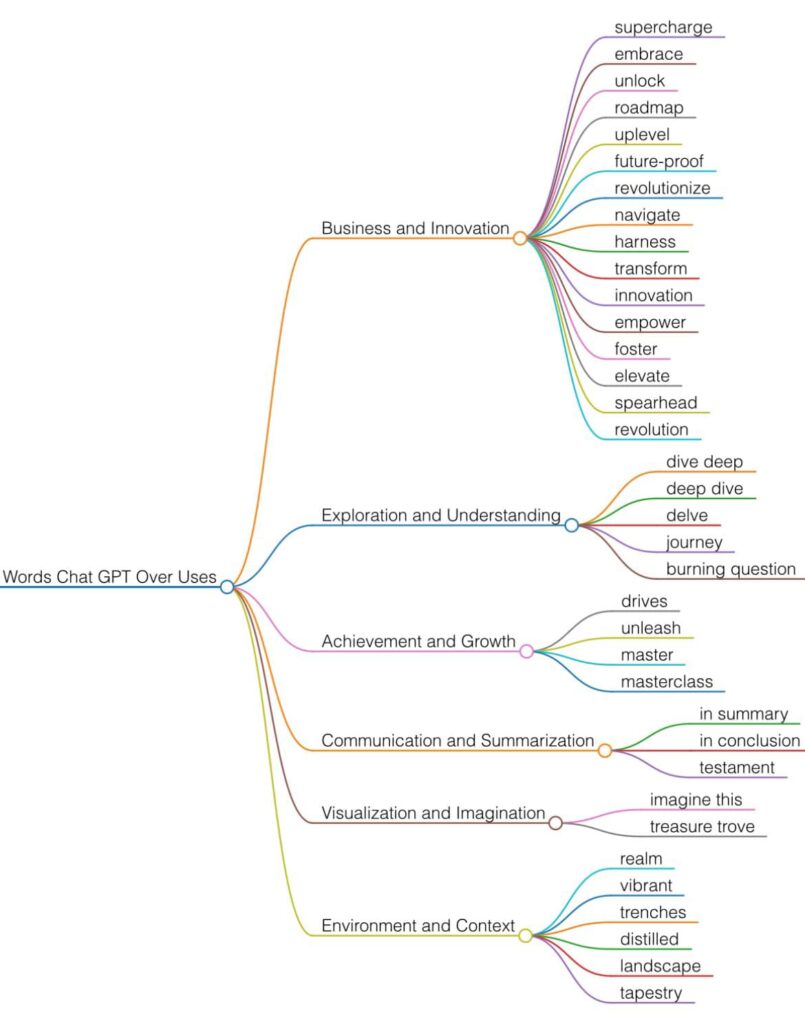

A ChatGPT és más nagy nyelvi modellek hajlamosak szokatlanul gyakran használni egyes szavakat és kifejezéseket. A University College London kutatója a ChatGPT megjelenése előtt és után publikált tanulmányokat vizsgálta, és azt találta, hogy bizonyos kifejezések előfordulási aránya többszörösére nőtt az elmúlt évben, ami nem igazán magyarázható mással, mint a mesterséges intelligencia egyre gyakoribb alkalmazásával.

A szerző szerint több mint 60 ezer tanulmányban lehetett kimutatni ezt a hatást, és bár az esetek többségében a ChatGPT-t valószínűleg csak a szöveg „csiszolására” használják, aggodalomra ad okot az, hogy ezeket a módosításokat általában nem jelentik be a tudományos folyóiratoknak. Ez a gyakorlat hosszú távon károsíthatja a tudományos kommunikáció minőségét és hitelességét.

Az Adobe szolgáltatása továbbra sem nyújt olyan pluszt, ami ne lenne máshol (akár ingyen) elérhető. A Firefly fő előnye, hogy a grafikusok által megszokott felületeken, a Photoshopon belül elérhetőek az AI eszközök.